2 Einträge gefunden

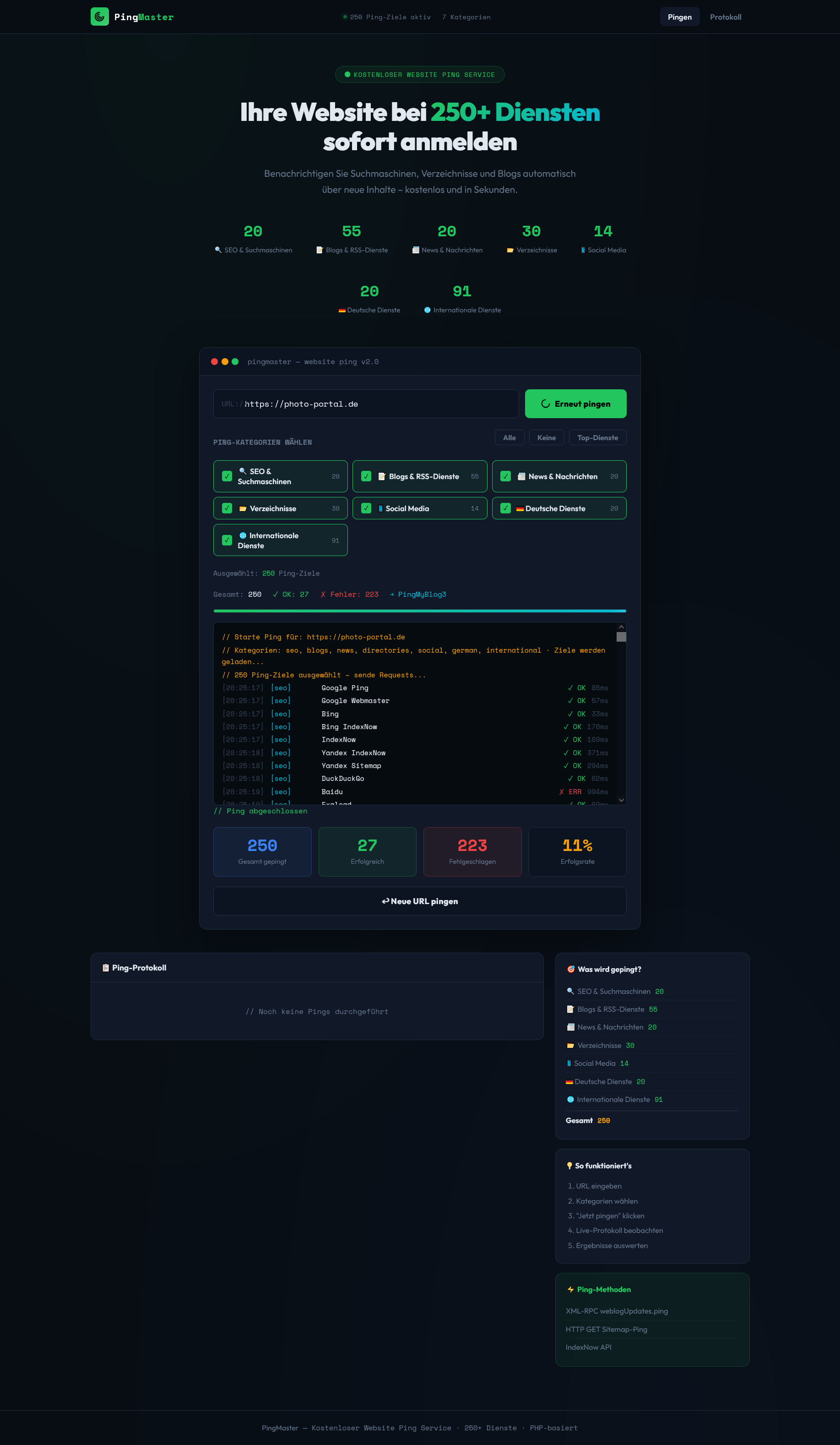

# 📡 PingMaster – Website Ping Service Kostenloses PHP-Skript zum automatischen Pingen Ihrer Website an 500+ Suchmaschinen, Verzeichnisse und Dienste. ## Features - **500+ Ping-Ziele** in 7 Kategorien - **Live-Terminal** – Ping-Ergebnisse in Echtzeit per AJAX - **Kategorien wählbar** – SEO, Blogs, News, Verzeichnisse, Social, Deutsche Dienste, International - **Ping-Protokoll** – bis zu 500 Einträge mit Erfolgsrate - **3 Ping-Methoden** – XML-RPC, HTTP GET, IndexNow - **Modernes Dark-Design** – Terminal-Ästhetik - **Keine Datenbank nötig** – JSON-basiertes Log-System ## Installation 1. ZIP entpacken auf Webserver 2. Browser: `https://ihredomain.de/ping/` 3. Fertig – keine Konfiguration nötig! ## Dateistruktur ``` / ├── index.php Hauptseite mit Ping-Formular ├── ping-ajax.php AJAX-Backend für Ping-Batches ├── log.php Ping-Protokoll ├── functions.php Ping-Engine, XML-RPC, Logging ├── /data/ │ └── ping-targets.php 500+ Ping-Ziele (kategorisiert) └── /logs/ └── ping-history.json Automatisch generiert ``` ## Ping-Kategorien | Kategorie | Dienste | Beschreibung | |-----------|---------|--------------| | 🔍 SEO & Suchmaschinen | 20 | Google, Bing, Yandex, IndexNow... | | 📝 Blogs & RSS | 54 | Technorati, Pingomatic, Feedster... | | 📰 News | 20 | Google News, Topix, Digg... | | 📂 Verzeichnisse | 30 | DMOZ, Yahoo Dir, Delicious... | | 📱 Social Media | 14 | Twitter, LinkedIn, Xing, Tumblr... | | 🇩🇪 Deutsche Dienste | 20 | Ping.de, Bloggerei.de, Yigg... | | 🌐 International | 90+ | PingOMatic, Pingler, BulkPing... | ## Ping-Methoden **XML-RPC** (Hauptmethode): ```xml <methodCall> <methodName>weblogUpdates.ping</methodName> <params> <param><value><string>Titel</string></value></param> <param><value><string>https://ihrewebsite.de</string></value></param> </params> </methodCall> ``` **HTTP GET** (Suchmaschinen): ``` https://www.google.com/ping?sitemap=https://ihrewebsite.de/sitemap.xml https://api.indexnow.org/indexnow?url=https://ihrewebsite.de ``` ## Konfiguration In `functions.php` anpassbar: - `TIMEOUT` (Standard: 3 Sek. pro Ping) - `LOG_MAX_ENTRIES` (Standard: 500) In `ping-ajax.php`: - `BATCH_SIZE` (Standard: 12 Ziele pro AJAX-Request) ## Anforderungen - PHP 7.4+ (empfohlen: 8.0+) - `allow_url_fopen = On` (für GET-Pings) - `fsockopen` verfügbar (für XML-RPC-Pings) - Schreibrecht auf `/logs/` Ordner ## Troubleshooting **Viele Fehler / langsam:** - Timeout-Wert erhöhen: `TIMEOUT = 5` - Manche Dienste sind inaktiv – das ist normal (20-40% Fehlerrate erwartet) **Permission denied /logs/:** ```bash chmod 755 logs/ ``` **allow_url_fopen deaktiviert:** XML-RPC-Pings funktionieren trotzdem über fsockopen. --- PHP 7.4+ · Keine Datenbank · Keine API-Keys · Sofort einsatzbereit

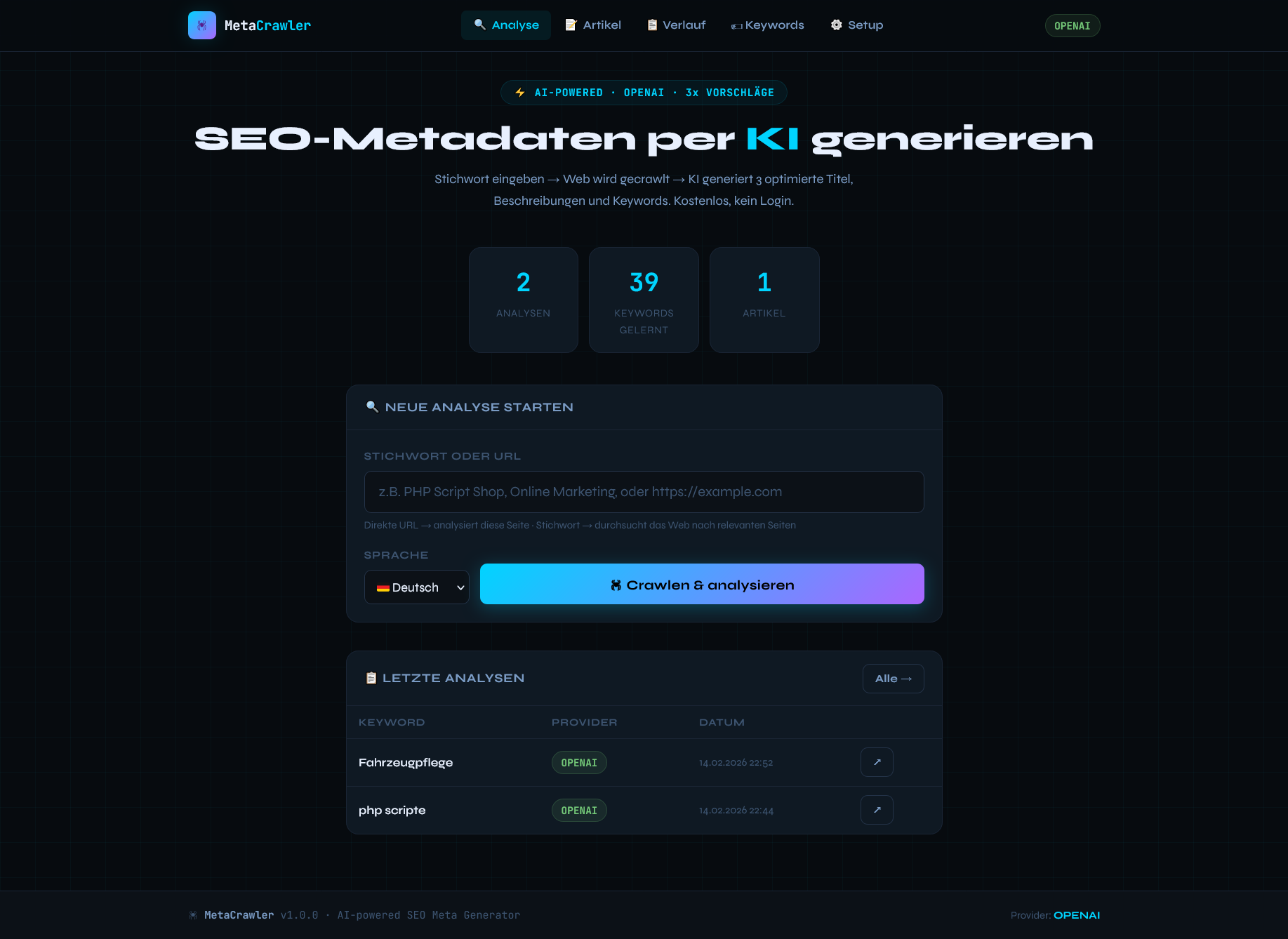

# 🕷 MetaCrawler ### AI-powered SEO Meta Generator · v1.0.0 MetaCrawler crawlt das Web nach einem Stichwort oder einer URL, analysiert die gefundenen Seiten und generiert mithilfe einer KI automatisch **3 optimierte Vorschläge** für Titel, Meta-Description und Keywords. Zusätzlich können vollständige Artikel generiert werden. **Komplett kostenlos nutzbar · Kein Login · Kein Abo · Einmal einrichten, dauerhaft nutzen.** --- ## ✨ Features | Feature | Beschreibung | |---|---| | 🔍 **Web-Crawling** | Bing, DuckDuckGo, Wikipedia + direkte URLs | | 🤖 **Multi-Provider AI** | OpenAI, Claude, Gemini, Mistral, Ollama | | 📊 **3 Vorschläge** | Titel (50–60 Z.), Description (150–160 Z.), Keywords | | 📝 **Artikel-Generator** | ~800 Wörter, 4 Schreibstile, DE + EN | | 🧠**Lernpool** | Wörter aus Crawls werden gespeichert & gewichtet | | 📥 **JSON-Export** | Jede Analyse als JSON-Datei exportierbar | | 💾 **SQLite** | Kein MySQL nötig – läuft auf jedem Hosting | | 🌐 **DE + EN** | Deutsche und englische Ausgabe wählbar | --- ## 🚀 Installation ### 1. Voraussetzungen | Anforderung | Version | |---|---| | PHP | 8.0 oder höher | | cURL Extension | Pflicht | | PDO SQLite Extension | Pflicht | | Schreibrechte | `storage/` und `logs/` Ordner | ### 2. Dateien hochladen Alle Dateien in ein Verzeichnis auf dem Webserver hochladen, z.B.: ``` https://ihre-domain.de/metacrawler/ ``` ### 3. config.php anpassen ```php // Provider wählen define('AI_PROVIDER', 'claude'); // openai | claude | gemini | mistral | ollama // Nur den gewählten Provider ausfüllen: define('CLAUDE_API_KEY', 'sk-ant-...'); define('CLAUDE_MODEL', 'claude-3-5-haiku-20241022'); ``` ### 4. Ordner-Rechte setzen ```bash chmod 755 storage/ chmod 755 logs/ ``` ### 5. Fertig – aufrufen ``` https://ihre-domain.de/metacrawler/ ``` Die SQLite-Datenbank wird beim ersten Aufruf automatisch erstellt. --- ## 🤖 AI-Provider Übersicht ### OpenAI - **API-Key**: https://platform.openai.com/api-keys - **Empfohlenes Modell**: `gpt-4o-mini` (günstig, schnell) - **Kosten**: ~$0.15 / 1M Input-Tokens ```php define('AI_PROVIDER', 'openai'); define('OPENAI_API_KEY', 'sk-...'); define('OPENAI_MODEL', 'gpt-4o-mini'); ``` --- ### Anthropic Claude - **API-Key**: https://console.anthropic.com/ - **Empfohlenes Modell**: `claude-3-5-haiku-20241022` (schnell & günstig) - **Kosten**: ~$0.25 / 1M Input-Tokens ```php define('AI_PROVIDER', 'claude'); define('CLAUDE_API_KEY', 'sk-ant-...'); define('CLAUDE_MODEL', 'claude-3-5-haiku-20241022'); ``` --- ### Google Gemini - **API-Key**: https://makersuite.google.com/app/apikey - **Empfohlenes Modell**: `gemini-1.5-flash` - **Kosten**: Kostenlos bis 1M Tokens/Monat ```php define('AI_PROVIDER', 'gemini'); define('GEMINI_API_KEY', 'AIza...'); define('GEMINI_MODEL', 'gemini-1.5-flash'); ``` --- ### Mistral AI - **API-Key**: https://console.mistral.ai/api-keys/ - **Empfohlenes Modell**: `mistral-small-latest` - **Kosten**: ~$0.20 / 1M Tokens ```php define('AI_PROVIDER', 'mistral'); define('MISTRAL_API_KEY', '...'); define('MISTRAL_MODEL', 'mistral-small-latest'); ``` --- ### Ollama (lokal – kostenlos) - **Download**: https://ollama.ai - **Kein API-Key nötig** – läuft komplett lokal - **Kosten**: 100% kostenlos ```bash # Ollama installieren & Modell laden ollama pull llama3.2 ollama serve ``` ```php define('AI_PROVIDER', 'ollama'); define('OLLAMA_HOST', 'http://localhost:11434'); define('OLLAMA_MODEL', 'llama3.2'); ``` > **Hinweis:** Ollama funktioniert nur wenn MetaCrawler auf demselben Server > wie Ollama läuft (Localhost). Für Shared-Hosting empfiehlt sich ein Cloud-Provider. --- ## 📁 Dateistruktur ``` metacrawler/ ├── config.php ← Konfiguration (Provider, API-Keys) ├── index.php ← Hauptseite: Analyse & 3 Vorschläge ├── artikel.php ← Artikel-Generator ├── history.php ← Analyse-Verlauf ├── keywords.php ← Keyword-Lernpool visualisiert ├── einstellungen.php ← Setup-Übersicht & Systeminfo │ ├── includes/ │ ├── header.php ← Navigation & CSS │ ├── footer.php ← Footer │ ├── crawler.php ← Web-Crawling Engine (cURL + Parser) │ ├── ai.php ← Multi-Provider AI Interface │ └── storage.php ← SQLite Datenbankschicht & Lernfunktion │ ├── storage/ │ ├── metacrawler.db ← SQLite Datenbank (auto-erstellt) │ └── exports/ ← JSON-Exporte │ └── logs/ ← Fehler-Logs ``` --- ## 🧠Lernfunktion Bei jeder Analyse extrahiert MetaCrawler die häufigsten Wörter aus allen gecrawlten Seiten und speichert sie in der lokalen SQLite-Datenbank (`keywords`-Tabelle). **Was passiert konkret:** - Stoppwörter (der, die, das, the, and, ...) werden gefiltert - Wörter unter 3 Zeichen werden ignoriert - Jedes Wort erhält einen Häufigkeitszähler - Bei erneuter Verwendung wird der Zähler erhöht **Auswirkung:** - Auf der Hauptseite werden verwandte Keywords aus dem Lernpool vorgeschlagen - Je mehr Analysen, desto treffsicherer die Vorschläge - Unter `keywords.php` ist der gesamte Lernpool als Wortwolke sichtbar --- ## 📊 Seiten-Übersicht ### 🔍 index.php – Analyse Stichwort oder URL eingeben → Web wird gecrawlt → KI generiert 3 Vorschläge. Jeder Vorschlag enthält: - **Title Tag** mit Zeichenzähler (Ziel: 50–60 Zeichen, grün markiert) - **Meta Description** mit Zeichenzähler (Ziel: 150–160 Zeichen) - **Keywords** als klickbare Tags - **\"Alles kopieren\"** Button – alle 3 Felder in einem Rutsch ### 📝 artikel.php – Artikel-Generator Generiert einen ~800-Wörter-Artikel auf Basis gecrawlter Daten. Schreibstile: - **Informativ** – sachlich, für breites Publikum - **Blog** – locker, persönlich, mit \"Ich/Wir\" - **SEO-optimiert** – höhere Keyword-Dichte - **Verkauf** – überzeugend, mit Call-to-Actions ### 📋 history.php – Verlauf Alle bisherigen Analysen. Details und JSON-Export pro Eintrag. ### 🏷 keywords.php – Lernpool Alle gesammelten Keywords als gewichtete Wortwolke. Je häufiger ein Begriff gefunden wurde, desto größer dargestellt. ### ⚙️ einstellungen.php – Setup - Übersicht aller Provider mit Konfigurationsbeispielen - Links zu den jeweiligen API-Key-Seiten - Systemprüfung (PHP-Version, cURL, SQLite, Schreibrechte) --- ## 🔧 Konfigurationsreferenz ```php // config.php – alle Optionen // Provider (eines wählen) define('AI_PROVIDER', 'claude'); // openai | claude | gemini | mistral | ollama // Crawling-Einstellungen define('CRAWL_TIMEOUT', 10); // Sekunden pro Request define('CRAWL_MAX_URLS', 5); // Max. zu crawlende URLs pro Analyse define('CRAWL_USER_AGENT', '...'); // User-Agent-String // Limits define('FREE_SUGGESTIONS', 3); // Anzahl Vorschläge pro Analyse define('FREE_ARTICLE_LEN', 800); // Ziel-Wortanzahl für Artikel // Sprache define('DEFAULT_LANG', 'de'); // de | en define('TIMEZONE', 'Europe/Berlin'); ``` --- ## 🔒 Sicherheitshinweise - Die `config.php` enthält API-Keys – Zugriff per `.htaccess` schützen: ```apache # .htaccess im Hauptverzeichnis <Files \"config.php\"> Order allow,deny Deny from all </Files> ``` - Den `storage/` Ordner vor direktem Webzugriff schützen: ```apache # storage/.htaccess Deny from all ``` - Den `logs/` Ordner ebenfalls schützen: ```apache # logs/.htaccess Deny from all ``` --- ## 🗺 Geplante Erweiterungen (Roadmap) > Diese Features sind **noch nicht implementiert** und können in einer späteren Version > hinzugefügt werden. ### 👤 Benutzerverwaltung (Login/Register) - Eigene Analyse-Historien pro Nutzer - Eigene Keyword-Listen und Projekte - Getrennte Lernpools pro Nutzer ### 💳 Premium-Modell - Kostenlose Version: 3 Analysen/Tag - Premium (Einmalkauf oder Abo): Unbegrenzte Analysen - PayPal IPN Integration (analog PasswortBox) ### 📦 Projekt-Verwaltung - Mehrere URLs/Keywords als \"Projekt\" zusammenfassen - Regelmäßige Re-Analyse (Cron-Job) mit Änderungs-Benachrichtigung - Vergleich: Wie haben sich Rankings verändert? ### 🔄 Bulk-Analyse - CSV-Upload mit mehreren Keywords/URLs - Batch-Verarbeitung im Hintergrund - Export als Excel/CSV ### 📈 Ranking-Tracking - Keyword-Positionen bei Google/Bing tracken - Historische Verläufe und Grafiken - Benachrichtigung bei Positions-Änderungen ### 🌍 Mehr Crawling-Quellen - Google (mit Proxy-Rotation) - Reddit, Quora für Community-Keywords - Amazon (für Produkt-Keywords) - YouTube (für Video-SEO) ### 🔌 API-Endpunkt - REST-API für externe Anbindung - Webhook-Support - WordPress-Plugin --- ## ❓ Häufige Fragen **Warum werden manchmal keine Ergebnisse gefunden?** Manche Websites blockieren Crawler. Versuche ein anderes Stichwort oder eine direkte URL einer zugänglichen Seite. **Warum ist die AI-Antwort manchmal unvollständig?** Bei günstigeren Modellen (z.B. Haiku, gpt-4o-mini) kann das Token-Limit erreicht werden. In `ai.php` den `$maxTokens`-Wert in der `complete()`-Methode erhöhen. **Kann ich MetaCrawler auf Shared-Hosting betreiben?** Ja, solange PHP 8+, cURL und PDO-SQLite verfügbar sind. Ollama funktioniert nur auf eigenen Servern (VPS/Root-Server). **Wo werden die Daten gespeichert?** Ausschließlich lokal in `storage/metacrawler.db` (SQLite). Es werden keine Daten an externe Server gesendet außer an den gewählten AI-Provider. **Wie kann ich den Lernpool zurücksetzen?** Die Datei `storage/metacrawler.db` löschen. Sie wird beim nächsten Aufruf neu erstellt. --- ## 📄 Lizenz MIT Einzel-License – frei verwendbar, anpassbar. Bei Weitergabe bitte diese README beilegen. --- *MetaCrawler v1.0.0 · Erstellt mit PHP 8 · SQLite · Web Crypto API*